Entrez la description de la scène vidéo que vous souhaitez implémenter dans votre esprit, et vous pouvez obtenir une présentation vidéo vive en peu de temps. Une telle "magie" est devenue une réalité dans les maquettes vidéo.

Récemment, le modèle de base de génération visuelle d'Alibaba Cloud Wanxiang 2.1 (WAN) a annoncé l'Open Source, prenant en charge les tâches vidéo vidéo et Tusheng Wensheng. Si vous comprenez la force de ce grand modèle d'une manière simple, c'est qu'elle a d'abord réalisé une performance de premier plan dans le domaine de la vidéo Wensheng. Parmi eux, le modèle 14B Million-Phases a des performances exceptionnelles dans la conformité des commandements, la génération de mouvement complexe, la modélisation physique, la génération de vidéos texte, etc. Dans l'ensemble d'évaluation faisant autorité VBench, les résultats du Wanxian 2.1 ont considérablement dépassé les modèles domestiques et étrangers tels que Sora, Luma et Pika, et ont été classés en premier dans la liste. Deuxièmement, similaire à Deepseek est que Deepseek a réalisé une réduction significative du coût de la formation de grands modèles, tandis que Wanxiang a réduit le seuil de déploiement de grands modèles au "niveau de consommation": Alibaba Cloud a déclaré que tant que la carte graphique de la catégorie peut également être déployée et conçue.

"Excellentes performances et accessibles".

Confronté à une nouvelle vague d'open source du modèle vidéo, les journalistes de Southern + ont exclusivement interviewé Zhang Ningyi, chef du produit Alibaba Tongyi Wanxiang, pour discuter du développement technologique et des tendances futures du modèle vidéo.

"En fait, nous avons innové dans l'ensemble du lien tel que la structure du modèle, les stratégies de pré-formation et l'inférence". "Par exemple, dans l'optimisation de l'architecture des modèles: la compression de l'espace-temps (4 fois dans le domaine temporel, 64 fois dans le domaine de l'air, 256 fois dans le taux de compression total) est obtenu via le" module 3D VAE ", qui réduit considérablement la consommation de vidéos de mémoire, la" stratégie de cache de caractéristique bloquée "est utilisée pour soutenir la génération de vidéos longue et les cartes graphiques de niveau consommateur (telles que RTX 4090). »

Il n'est pas difficile de voir dans l'évolution de Wanxian 2.1 qu'en tant que toute nouvelle technologie, même si elle est actuellement dans la "War Model War", elle a également la possibilité de dépasser.

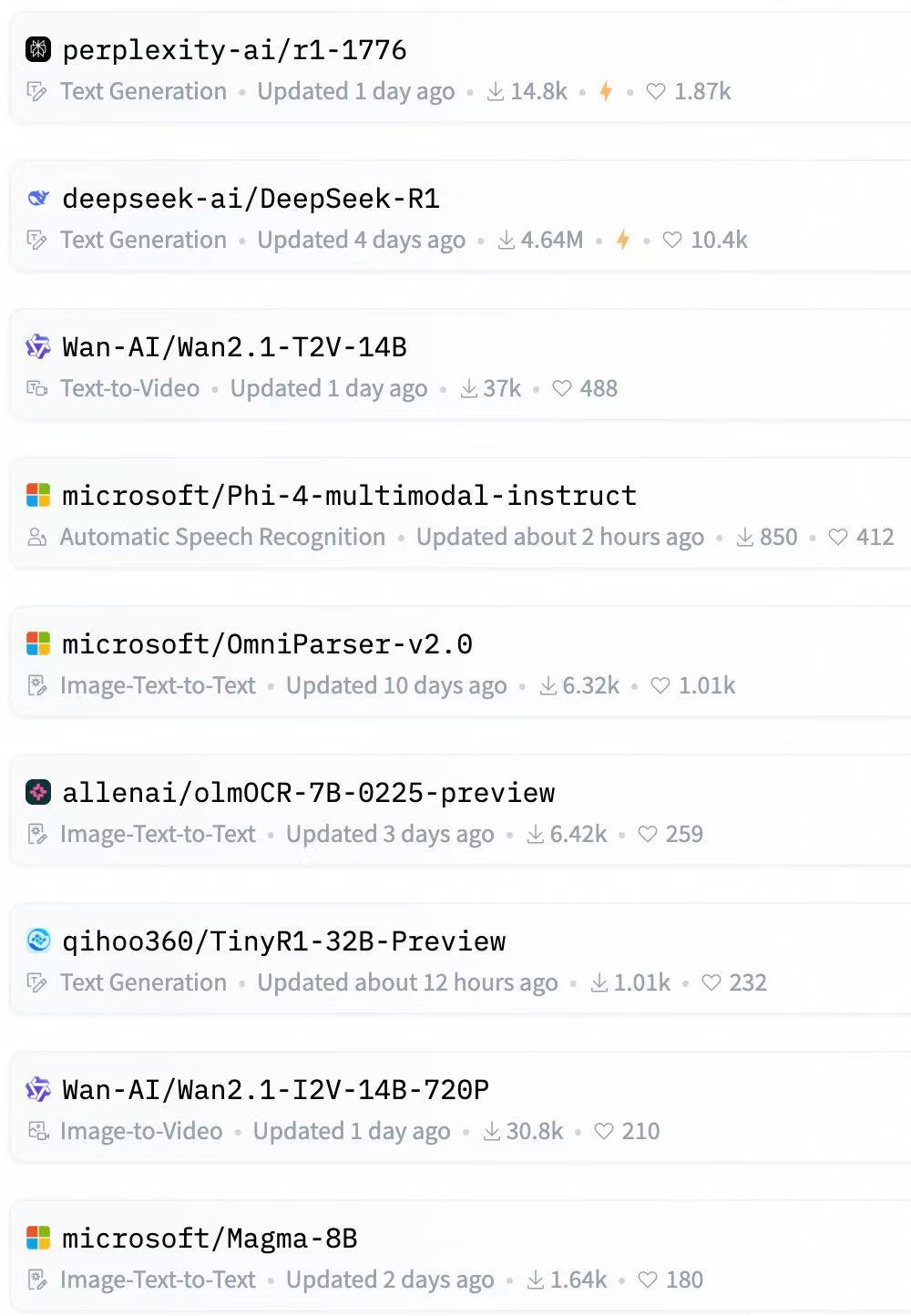

"Du point de vue de la performance du modèle, Wanxiang devient une nouvelle référence dans le domaine de la génération de vidéos." P vidéo, qui constitue une réduction de 30% de la demande de mémoire vidéo par rapport aux modèles similaires, et est à la pointe du "modèle vidéo convivial au niveau des consommateurs". "Les commentaires de la communauté sont plus intuitifs. Nous avons été répertoriés à la troisième place sur la liste de popularité de l'étreinte en moins de deux jours après avoir ouvert la source. Un grand nombre de développeurs déploient et expérimentent les modèles de dix mille phases."

Une fois que Deepseek est devenu populaire, "le serveur est occupé" est devenu la "première impression" de tout le monde à ce sujet. En tant que modèle vidéo avec des exigences de puissance de calcul plus élevées, des exigences plus élevées sont également proposées. Zhang Ningyi a déclaré que pour faire face à la demande de croissance exponentielle de puissance de calcul GPU, en particulier le marché de l'inférence explosif, le cloud Alibaba a reconstruit le matériel sous-jacent, l'informatique, le stockage, le réseau, la base de données et les mégadonnées, et l'adaptation organique et intégrée avec les scénarios AI pour accélérer le développement et l'application de modèles et créent l'Enfrasture Strong Infrastructure et de créer des modèles Strongs. Selon Zhang Ningyi, Alibaba Cloud a construit une infrastructure d'IA stable et efficace, la durée effective de l'entraînement continu dépassant 99%, et le taux d'utilisation de la puissance de calcul du modèle a augmenté de plus de 20%.

Il convient de noter que suivre la "route open source" avec Deepseek est également une raison importante pour laquelle le grand modèle de Wanxiang est rapidement devenu populaire. Zhang Ningyi a déclaré que le double modèle open source 14b / 1.3b peut explorer davantage la technologie de génération de vidéos avec la communauté universitaire et, en même temps, ainsi que l'industrie, favoriser l'application d'une technologie de modèle à grande échelle dans des milliers d'industries. "Aliyun a d'abord proposé le concept de MaaS (Model-As-A-Service) par Alibaba Cloud. La communauté Alibaba Cloud Modai fournit aux développeurs AI des services à guichet unique tels que la communauté Modai, le téléchargement, le réglage, les modèles nationaux et étrangers tels que les modèles à la fois de Kianwen, Wanxiang Wan,".}

En moins de deux jours d'open source, Wanxiang s'est classé troisième sur la liste chaude de Huggingface

En vue des initiés de l'industrie, le chemin open source réduit en outre le seuil d'application des grands modèles, et l'arrivée des grands modèles vidéo apportera une valeur d'application beaucoup plus grande que Deepseek ne peut qu'atteindre le dialogue de texte auparavant.

"Au cours des deux dernières années, les performances de modèles à grande échelle de divers modes ont été considérablement améliorées, mais pour obtenir une mise en œuvre à grande échelle, c'est un moyen important de les modèles efficaces open source. Nous espérons que le grand modèle de Wanxiang peut permettre aux créateurs individuels et aux petites et moyennes équipes de générer des films et de la télévision, une amélioration de l'université créative, une amélioration de l'universalité" Big Model promouvra efficacement le développement du cinéma et de la télévision et de l'animation, du commerce électronique et du marketing, de l'éducation et des sciences populaires: visualisation dynamique des concepts abstraits (tels que les lois physiques, la croissance biologique), le développement de jeux et d'autres domaines, et utiliser les grands modèles pour générer rapidement des prises de vue, aider la conception du storyboard et générer des vidéos d'affichage de produits avec un clic sur un seul clic.

concernant les changements et les impacts qui seront provoqués par le grand modèle après être entré dans l'ère vidéo, Zhang Ningyi a admis qu'elle ferait la promotion d'un changement complet dans le domaine de la création de contenu.. "À l'avenir, les gens ordinaires peuvent générer des vidéos courtes via un langage naturel pour avoir un impact comme la génération de vidéos d'enseignement avec narration). "

Écrit par: Southern + Reporter Ye Dan

Éditeur: Southern + Reporter Long Dayang tornadobinance